I det siste har vi kommet over uttrykket LiDAR-sensor mye i artikler om kameraer på nye Apple-enheter. Denne setningen blir kastet rundt så mye at vi glemmer at Augmented Reality-telefoner kan fungere på alle måter, spesielt med ToF-verktøy som tar Samsung-telefoner til neste nivå.

Så hvor er forskjellen mellom LiDAR og ToF? La oss finne ut av det med Quantrimang.

Hva er ToF?

ToF står for Time of Flight. Faktisk involverer ToF lysets hastighet (eller til og med lyd) for å bestemme avstanden. Den måler tiden det tar for lys å forlate enheten, nå objektet og returnere, alt delt inn i to perioder som indikerer avstanden fra enheten til objektet eller overflaten.

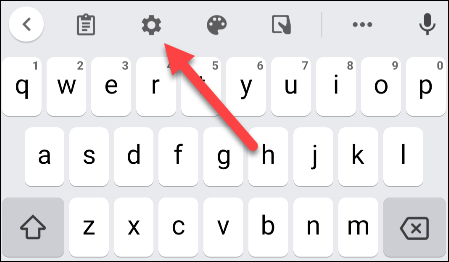

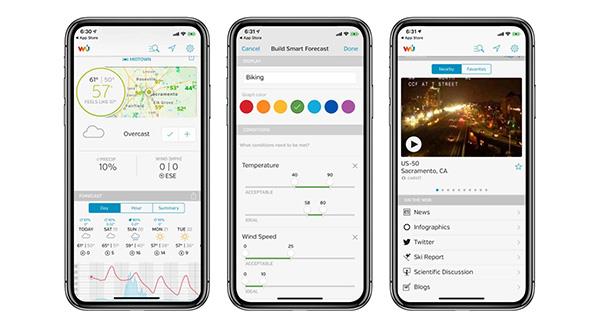

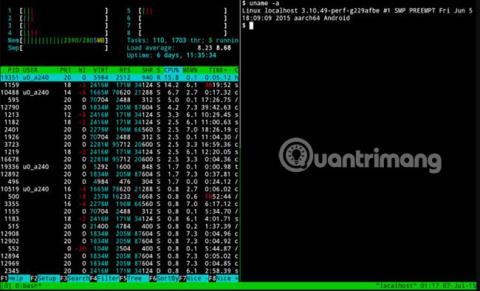

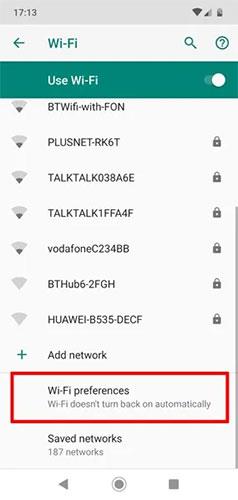

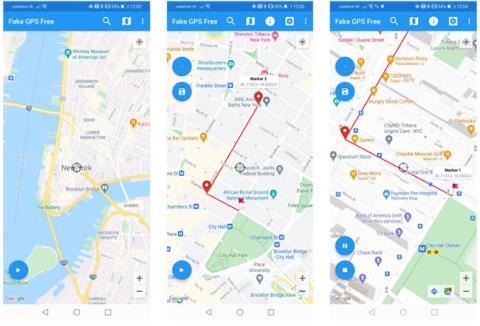

Android-enheter bruker ToF-sensorer

Så all LiDAR er en type Time of Flight, men ikke alle ToF er LiDAR. Enkelt sagt betyr ToF optisk avstandsmåling, som ikke er relatert til LiDAR.

Hva er LiDAR?

LiDAR står for Light Detection and Ranging. Denne teknologien bruker en laser, eller en laserstråle samt en lignende lyskilde som ovenfor.

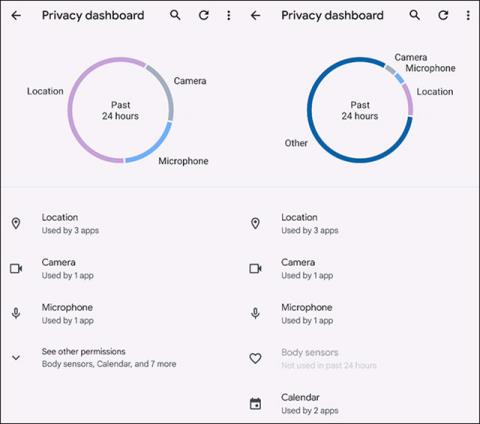

LiDAR-sensor på iPhone

En enkelt LiDAR-sensor kan brukes til å måle bredden på et rom, men flere LiDAR-sensorer kan brukes til å lage en "punktsky". Disse punktene brukes til å lage en 3D-modell av et objekt eller et topografisk kart over et helt område.

Selv om LiDAR kan være nytt for mobile enheter, har teknologien faktisk eksistert en stund. Når det ikke er installert på en telefon, brukes LiDAR til å gjøre alt fra kartlegging av undervannsmiljøer til arkeologiske funnsteder.

Forskjellen mellom LiDAR og ToF

Den funksjonelle forskjellen mellom LiDAR og andre former for ToF er at LiDAR bruker en pulserende laser for å bygge en "punktsky", som deretter brukes til å bygge et kart eller 3D-bilde. ToF-applikasjoner lager "dybdekart" basert på lysdeteksjon, ofte gjennom et standard RGB-kamera.

Fordelen med ToF fremfor LiDAR er at ToF krever mindre spesialisert utstyr, slik at det kan brukes med små og rimeligere enheter. Fordelen med LiDAR kommer fra det faktum at datamaskiner enkelt kan lese punktskyer i forhold til dybdekart.

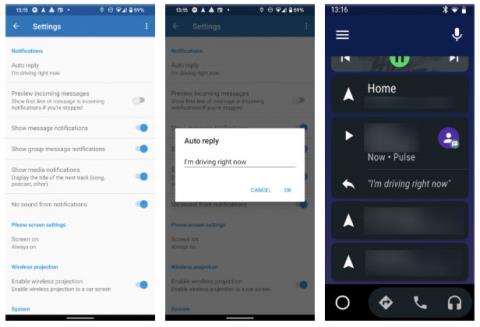

Dybde-APIet som Google laget for Android fungerer best på enheter som støtter ToF, ved å lage et dybdekart og gjenkjenne "funksjonspunkter". Disse funksjonspunktene er ofte barrierer mellom ulike lysintensiteter, som deretter brukes til å definere ulike plan i miljøet. Dette skaper i hovedsak en punktsky med lavere oppløsning.

Hvordan ToF og LiDAR fungerer med mobil AR

Dybdekart og punktskyer er flotte, og for noen brukere er det nok. For de fleste AR-applikasjoner må imidlertid disse dataene kontekstualiseres. Både ToF og LiDAR oppnår dette ved å jobbe sammen med andre sensorer på mobile enheter. Spesifikt må disse plattformene forstå telefonens orientering og bevegelse.

Er LiDAR bedre enn ToF?

For å være presis er LiDAR raskere og mer nøyaktig enn ToF. Dette blir imidlertid viktigere med nye teknologiapplikasjoner.

For eksempel har Googles ToF og Depth APIer problemer med å forstå store, lavteksturplan som hvite vegger. Dette kan gjøre det vanskelig for applikasjoner som bruker denne metoden å nøyaktig plassere digitale objekter på visse overflater i den fysiske verden. Det er mindre sannsynlig at applikasjoner som bruker LiDAR har dette problemet.

Imidlertid vil applikasjoner som involverer strukturelt forskjellige eller større miljøer sannsynligvis ikke oppleve dette problemet. Videre bruker de fleste mobilbaserte forbruker-AR-applikasjoner AR-filtre på brukerens ansikt eller kropp – en applikasjon som neppe vil støte på problemer på grunn av store overflater.

Hvorfor bruker Apple og Google forskjellige dybdesensorer?

Ved utgivelsen av LiDAR-kompatible enheter, sier Apple at de har kombinert sensorene med maskinvare for å "åpne opp mer profesjonelle arbeidsflyter, støtte profesjonelle foto- og videoapplikasjoner." Den LiDAR-kompatible iPad Pro er «verdens beste enhet for utvidet virkelighet», og lanseringsproduktet inkluderer Apples måleapper.

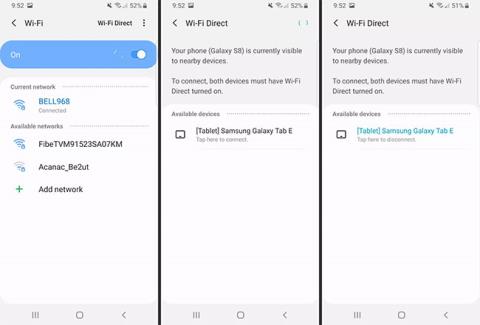

Google forklarer grundig hvorfor deres Depth API og den nye linjen med støtteenheter ikke bruker LiDAR. Å jobbe med LiDAR holder Android-enheter lettere og rimeligere, pluss at det er en stor fordel med tilgjengelighet.

Siden Android-telefoner produseres av mange selskaper, vil LiDAR-adopsjon favorisere LiDAR-kompatible modeller fremfor andre. Videre, fordi det bare krever et standardkamera, er Depth API bakoverkompatibel med flere enheter.