Den senaste tiden har vi stött på frasen LiDAR-sensor mycket i artiklar om kameror på nya Apple-enheter. Den här frasen kastas runt så mycket att vi glömmer att Augmented Reality-telefoner kan fungera hur som helst, speciellt med ToF-verktyg som tar Samsung-telefoner till nästa nivå.

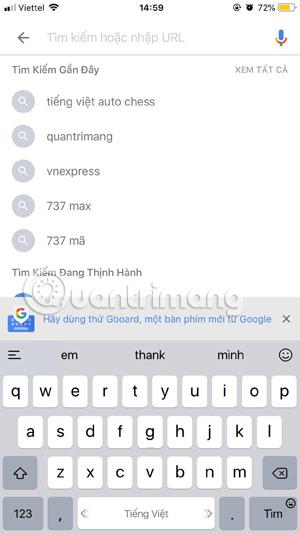

Så var är skillnaden mellan LiDAR och ToF? Låt oss ta reda på det med Quantrimang.

Vad är ToF?

ToF står för Time of Flight. Egentligen involverar ToF ljusets hastighet (eller till och med ljud) för att bestämma avståndet. Den mäter den tid det tar för ljus att lämna enheten, nå objektet och återvända, allt uppdelat i två perioder som anger avståndet från enheten till objektet eller ytan.

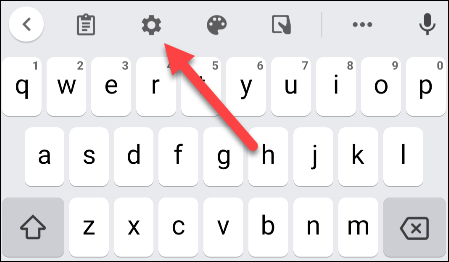

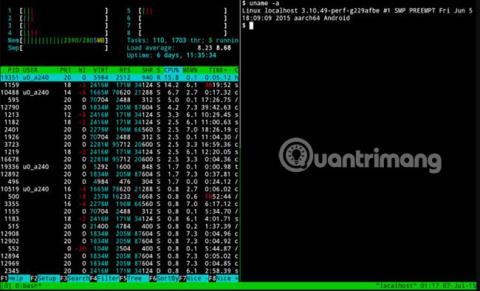

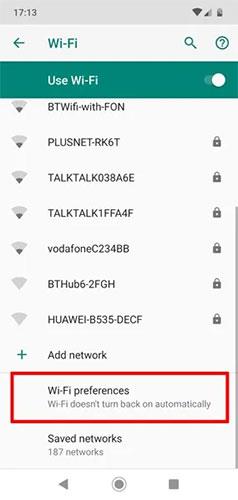

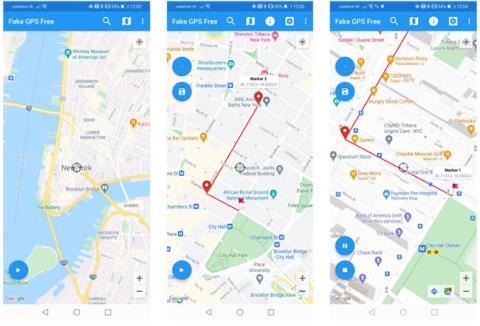

Android-enheter använder ToF-sensorer

Så all LiDAR är en typ av Time of Flight, men inte alla ToF är LiDAR. Enkelt uttryckt betyder ToF optisk avståndsmätning, vilket inte är relaterat till LiDAR.

Vad är LiDAR?

LiDAR står för Light Detection and Ranging. Denna teknik använder en laser, eller en laserstråle samt en liknande ljuskälla som ovan.

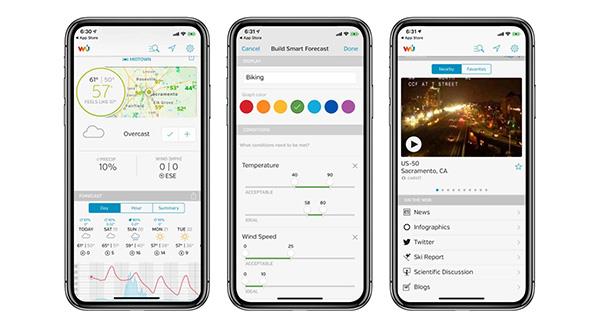

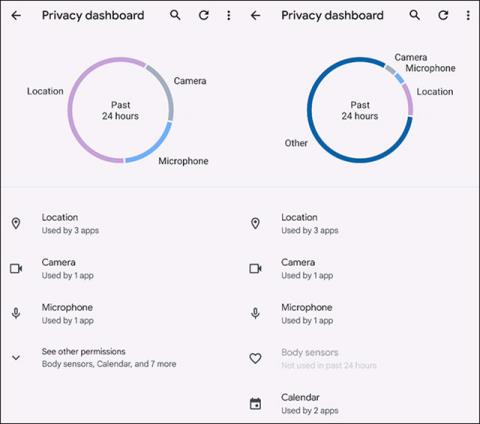

LiDAR-sensor på iPhone

En enda LiDAR-sensor kan användas för att mäta ett rums bredd, men flera LiDAR-sensorer kan användas för att skapa ett "punktmoln". Dessa punkter används för att skapa en 3D-modell av ett objekt eller en topografisk karta över ett helt område.

Även om LiDAR kan vara nytt för mobila enheter, har tekniken faktiskt funnits ett tag. När den inte är installerad på en telefon, används LiDAR för att göra allt från kartläggning av undervattensmiljöer till arkeologiska platser.

Skillnaden mellan LiDAR och ToF

Den funktionella skillnaden mellan LiDAR och andra former av ToF är att LiDAR använder en pulsad laser för att bygga ett "punktmoln", som sedan används för att bygga en karta eller 3D-bild. ToF-applikationer skapar "djupkartor" baserade på ljusdetektering, ofta genom en vanlig RGB-kamera.

Fördelen med ToF framför LiDAR är att ToF kräver mindre specialiserad utrustning så den kan användas med små och billigare enheter. Fördelen med LiDAR kommer från det faktum att datorer enkelt kan läsa punktmoln i förhållande till djupkartor.

Depth API som Google skapade för Android fungerar bäst på enheter som stöder ToF, genom att skapa en djupkarta och känna igen "funktionspunkter". Dessa särdrag är ofta barriärer mellan olika ljusintensiteter, som sedan används för att definiera olika plan i omgivningen. Detta skapar i huvudsak ett punktmoln med lägre upplösning.

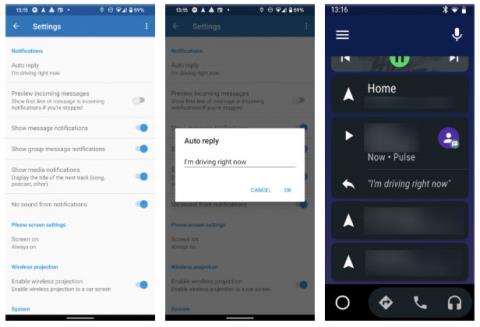

Hur ToF och LiDAR fungerar med mobil AR

Djupkartor och punktmoln är bra, och för vissa användare räcker det. Men för de flesta AR-applikationer måste dessa data kontextualiseras. Både ToF och LiDAR åstadkommer detta genom att arbeta tillsammans med andra sensorer på mobila enheter. Specifikt måste dessa plattformar förstå din telefons orientering och rörelse.

Är LiDAR bättre än ToF?

För att vara exakt är LiDAR snabbare och mer exakt än ToF. Detta blir dock viktigare med nya tekniktillämpningar.

Till exempel har Googles ToF och Depth API:er svårt att förstå stora plan med låg textur som vita väggar. Detta kan göra det svårt för applikationer som använder denna metod att exakt placera digitala objekt på vissa ytor i den fysiska världen. Applikationer som använder LiDAR är mindre benägna att ha detta problem.

Tillämpningar som involverar strukturellt olika eller större miljöer kommer sannolikt inte att uppleva detta problem. Dessutom använder de flesta mobilbaserade konsument-AR-applikationer AR-filter på användarens ansikte eller kropp – ett program som sannolikt inte kommer att stöta på problem på grund av stora ytor.

Varför använder Apple och Google olika djupsensorer?

Genom att släppa LiDAR-kompatibla enheter säger Apple att de har kombinerat sensorerna med hårdvara för att "öppna upp mer professionella arbetsflöden och stödja professionella foto- och videoapplikationer." Den LiDAR-kompatibla iPad Pro är "världens bästa enhet för förstärkt verklighet", och lanseringsprodukten inkluderar Apples mätappar.

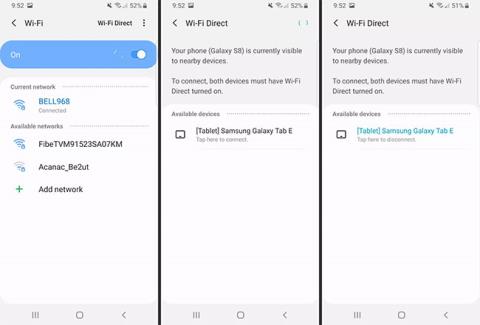

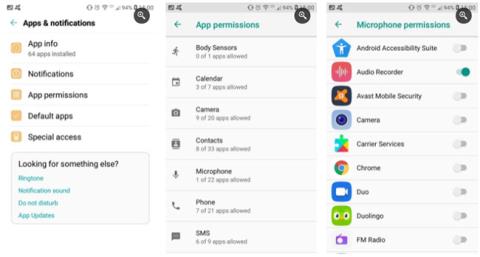

Google förklarar utförligt varför deras Depth API och den nya raden av stödjande enheter inte använder LiDAR. Att arbeta med LiDAR håller Android-enheter lättare och mer överkomliga, plus att det finns en stor fördel med tillgänglighet.

Eftersom Android-telefoner tillverkas av många företag kommer LiDAR att gynna LiDAR-kompatibla modeller framför andra. Dessutom, eftersom det bara kräver en standardkamera, är Depth API bakåtkompatibel med fler enheter.